AI Act: Wat betekent de nieuwe wetgeving voor Nederlandse overheidsorganisaties?

Samenvatting: Per 1 augustus 2024 is de AI-verordening, ook bekend als de AI Act, van kracht in Europa. AI-ontwikkelaars en organisaties die AI-systemen gebruiken moeten rekening houden met deze verordening. In deze blog leggen we uit wat de AI-verordening inhoudt en wat dit betekent voor overheidsorganisaties.

De opkomst van kunstmatige intelligentie (AI) biedt enorme mogelijkheden, maar roept ook belangrijke vragen op over veiligheid, ethiek en privacy. Om deze technologie op een verantwoorde manier te reguleren, heeft de Europese Unie de AI-verordening, ook wel de AI Act, opgesteld. Deze Europese AI-wetgeving is één van de eerste pogingen wereldwijd om AI-systemen te reguleren en focust op transparantie, veiligheid en het voorkomen van discriminatie in AI-toepassingen.

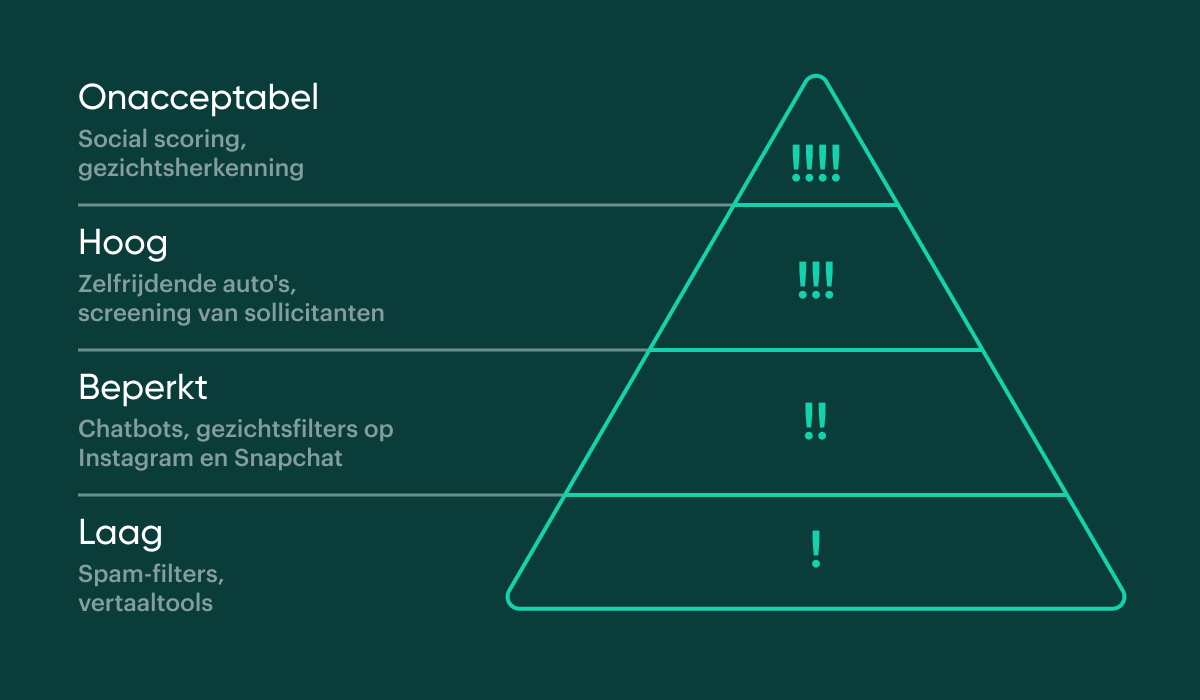

De verordening heeft een risicogebaseerde benadering, waarbij AI-systemen worden ingedeeld op basis van het risico dat ze vormen voor burgers, variërend van laag tot onacceptabel.

Waarom is de AI-verordening aangenomen?

AI wordt wordt steeds vaker gebruikt, zowel door burgers als in het bedrijfsleven. Naast de groei van AI nemen ook de zorgen toe over de risico's die deze technologie met zich meebrengt, zoals privacyschending, discriminatie en een gebrek aan transparantie in de beslissingen van AI-systemen. Daarnaast groeit de behoefte om het vertrouwen in AI-technologie te versterken. De AI Act moet er voor zorgen dat AI op een eerlijke en verantwoorde manier wordt gebruikt.

Het eerste voorstel voor een AI-wet, maakte de Europese Commissie in april 2021 bekend. Ruim drie jaar later is de allereerste AI-verordening in Europa van kracht gegaan. Sinds 1 augustus 2024 moeten overheden en andere organisaties zich aan de AI-regels houden om op een transparante, ethische en veilige manier met AI om te gaan.

Risiconiveaus AI-verordening

De AI-verordening heeft een risicogebaseerde aanpak. Dit betekent dat de regels strenger worden naarmate het risico op impact voor de samenleving toeneemt. De verschillende risicocategorieën zijn:

- Onacceptabel: AI-toepassingen die een directe dreiging vormen voor burgers zijn verboden, zoals social scoring en gezichtsherkenning.

- Hoog: AI-systemen waarbij de rechten, gezondheid of veiligheid van burgers in het geding komen zijn alleen onder strenge voorwaarden toegestaan, zoals zelfrijdende auto's, screening van sollicitanten.

- Beperkt: AI-toepassingen die burgers kunnen misleiden, zijn alleen toegestaan onder de voorwaarde dat het duidelijk is dat gebruikers met AI te maken hebben. Denk aan: chatbots of gezichtsfilters op Instagram en Snapchat.

- Laag: AI-toepassingen met minimale risico's voor burgers zijn zonder beperkingen veroorlooft, zoals spam-filters en vertaaltools.

In de komende blogs van deze AI-serie zullen we meer voorbeelden delen van AI-toepassingen binnen verschillende risicocategorieën.

AI Act in fasen ingevoerd

Omdat de AI Act uit veel onderdelen bestaat, zijn er fasen opgesteld. Zo krijgen organisaties en overheden de tijd om verboden AI-toepassingen uit te faseren. Verderop in deze blog vertellen we meer over deze fasen.

Fase 1: Verboden AI-systemen per 1 februari 2025

Het is belangrijk dat je organisatie vóór 1 februari 2025 voldoet aan de eisen uit de eerste fase. Dan zijn alle AI-systemen met onacceptabele risico's verboden. Het gaat hierbij om de volgende risico's:

- Manipulatie.

- Exploiteren van kwetsbare groepen.

- Social scoring.

- Real-time biometrische identificatie in openbare ruimtes.

- Misbruik van emotieherkenning en gedragscategorisatie.

Voor wie geldt de AI-verordening?

De AI-verordening geldt voor verschillende partijen die betrokken zijn bij de ontwikkeling, distributie en toepassing van AI-systemen binnen de Europese Unie:

- AI-ontwikkelaars die verantwoordelijk zijn voor het ontwerpen en bouwen van AI-oplossingen.

- Dienstverleners die AI-systemen beschikbaar maken aan andere bedrijven of eindgebruikers.

- Organisaties die AI-systemen implementeren in hun dagelijkse processen, zoals overheden, zorginstellingen en bedrijven.

Belangrijk om te weten is dat de verordening niet alleen van toepassing is op bedrijven die gevestigd zijn in de EU, maar ook op bedrijven van buiten de EU die AI-systemen aanbieden aan Europese gebruikers of hun diensten in Europa willen aanbieden. De reikwijdte van de AI-verordening is hierdoor breed. Zowel internationale als Europese organisaties moeten zich aan dezelfde regels houden om de veiligheid, openheid en rechten van burgers te beschermen.

Hoe worden organisaties gecontroleerd op het naleven van de AI-verordening?

De handhaving van de AI-verordening wordt streng en gestructureerd uitgevoerd door nationale en Europese toezichthoudende autoriteiten. Elk EU-land is verantwoordelijk voor het benoemen van een toezichthoudende instantie die de naleving van de verordening controleert binnen zijn eigen jurisdictie.

De bestuursorganen die zijn opgericht om de AI-verordening te handhaven zijn:

- AI-bureau: controleert binnen de Commissie om binnen de EU de gemeenschappelijke regels te handhaven.

- Wetenschappelijk panel van onafhankelijke deskundigen: ondersteunt bij activiteiten rondom handhaving.

- AI-comité: ondersteunt en adviseert Commissie en lidstaten om de AI-verordening consistent en effectief toe te passen.

- Adviesforum voor belanghebbenden: biedt technische expertise aan het AI-comité en de Commissie.

Wat betekent de AI-verordening voor jouw overheidsorganisatie?

Wanneer een bedrijf of organisatie zich niet aan de AI-verordening houdt, kunnen er forse boetes worden opgelegd. Deze zijn vergelijkbaar met de boetes onder de Algemene Verordening Gegevensbescherming (AVG). Boetes op de AI-verordening kunnen oplopen tot 35 miljoen euro of 7% van de jaaromzet, afhankelijk van de ernst van de overtreding en de grootte van de organisatie. Dit benadrukt hoe serieus de EU handhaving en naleving neemt om ervoor te zorgen dat AI-systemen veilig, ethisch en transparant worden gebruikt.

Het is dus belangrijk om goed in de gaten te houden wanneer je aan welke eisen moet voldoen.

Tijdlijn AI Act

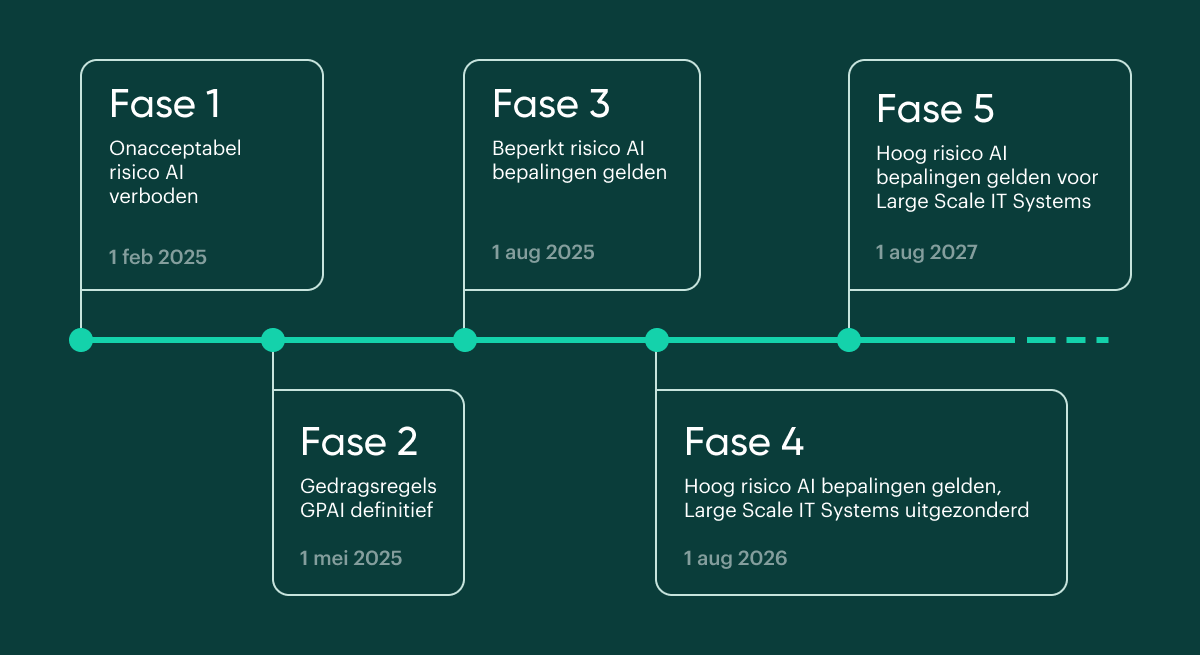

De EU heeft een tijdlijn opgesteld om de AI-verordening volledig door te voeren. Deze ziet er als volgt uit:

-

Fase 1 - 1 februari 2025

Verbod op het gebruik van AI-systemen met een onacceptabel risico. Verplichting tot AI-geletterdheid: medewerkers moeten voldoende vaardigheden, kennis en competenties hebben voor het gebruik van AI.

-

Fase 2 - 1 mei 2025

Deadline opstellen gedragscodes aanbieders General Purpose AI (GPAI*).

-

Fase 3 - 1 augustus 2025

Voldoen aan bepalingen uit categorie beperkt risico:

- GPAI-verplichtingen

- oprichten nationale toezichthouders

- publicatie richtlijnen voor toezicht en boetes

-

Fase 4 - 1 augustus 2026

Voldoen aan bepalingen uit categorie hoog risico, met uitzondering van Large Scale IT-systems.

-

Fase 5 - 1 augustus 2027

Large Scale IT-systems, zoals die voor grenscontroles, moeten ook voldoen aan de eisen van de categorie hoog risico.

* GPAI staat voor General Purpose AI. Dit zijn AI-systemen die je voor meerdere taken kunt inzetten, zonder dat ze vooraf specifiek voor één enkele toepassing zijn ontworpen. Een voorbeeld hiervan is GPT-3, het AI-model dat de basis vormt voor ChatGPT.

Lees in onze volgende blog hoe je in 5 stappen aan de eerste fase voldoet.

Meer informatie

- Meer over AI lees je in onze blog: 'De invloed van AI (artificial intelligence) op de overheid'.

- Website Digitale overheid

- Website EU Artificial Intelligence Act

- AI Act Explorer

- AI Act compliance checker

- Stel je vragen over de AI Act aan het ministerie van Binnenlandse Zaken en Koninkrijksrelaties (BZK): ai-verordening@minbzk.nl

Benieuwd hoe AI jouw documentverwerking kan verbeteren? Of hoe wij deze technologieën in onze software integreren?